英伟达黄仁勋演讲透露关键信息:NIM 可大幅缩短 AI 模型部署时间

6月2日晚间,英伟达创始人兼首席执行官黄仁勋登台演讲,透露了不少关键信息。据他介绍,使用 NIM将AI模型部署在云、数据中心或工作站上的开发者,可将模型部署时间从以前的数周缩短至几分钟。和硕、劳氏公司、西门子等客户均在使用。

此外,被英伟达寄予厚望的新一代AI芯片与超级计算平台芯片已开始投产,预计将在2025年推出 Ultra AI芯片。

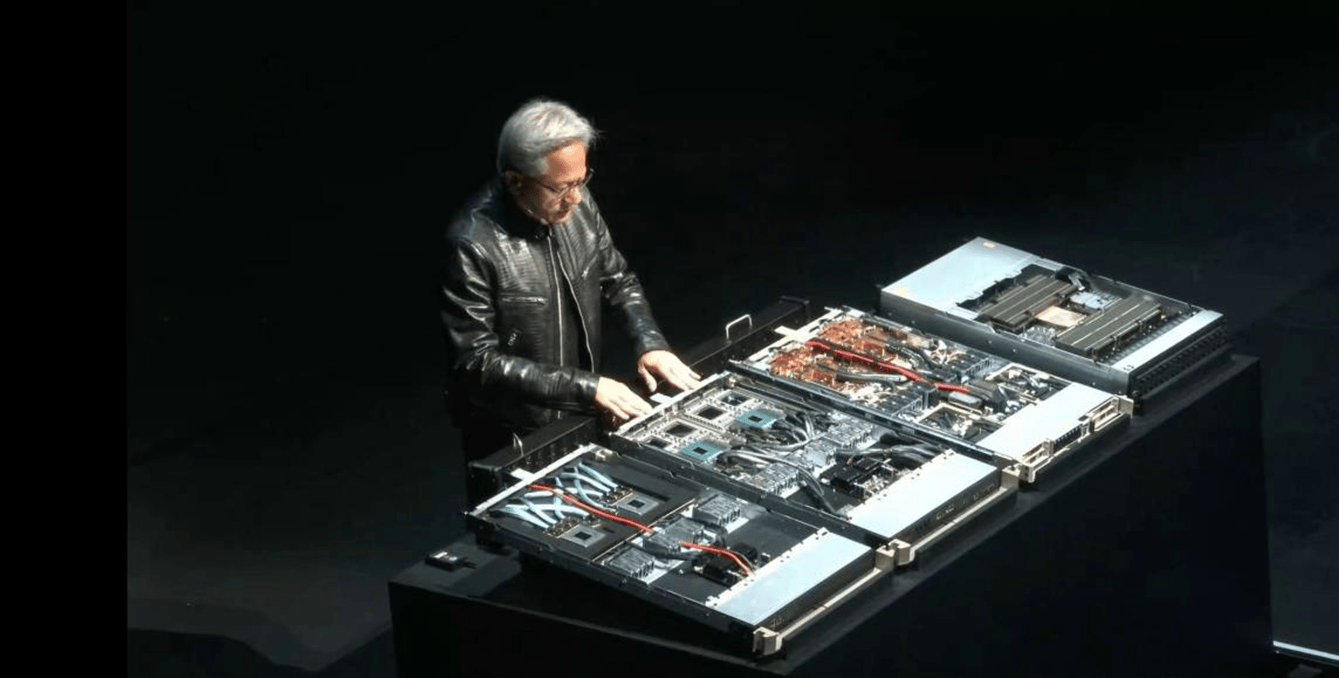

图片来源;黄仁勋演讲截图

可将模型部署时间从数周缩短至几分钟

6月2日晚间,一身皮衣的英伟达创始人黄仁勋又在舞台上摆弄起了自家产品,重磅介绍了,一种推理微服务,可通过经优化的容器形式提供模型,旨在助力各种规模企业部署AI服务。

不过,严格来说,并非新品,最早露面是在今年3月。英伟达在6月2日晚间宣布,全球2800万开发者皆可下载,将AI模型部署在云、数据中心或工作站上,构建(一种AI助理)、聊天机器人等生成式AI应用。下月起, 开发者计划的会员可免费使用NIM,在其选择的基础设施上进行研究、开发和测试。

根据英伟达的说法,新的生成式AI应用正变得越来越复杂,通常需要使用具有不同功能的多个模型来生成文本,如图像、视频、语音等。而提供了一种简单、标准化的方式——将生成式AI添加到应用中,可使模型部署时间从以前的数周缩短至几分钟。

黄仁勋还透露,包括 、、、、、Scale AI 和新思科技等近200家技术合作伙伴正在将NIM集成到他们的平台中,以加快生成式AI部署。“每个企业都希望在其运营中融入生成式AI,但并非每个企业都拥有专门的AI研究团队。 NIM 可被集成到任意平台中,任何地方的开发者都可以访问,并且可以在任意环境中运行。”黄仁勋称。

《每日经济新闻》记者了解到,NIM是预先构建的,目前有近40个模型可作为NIM的端点供开发者体验;开发人员可从开源社区平台 Face访问适用于Meta Llama 3模型的 NIM微服务,使用 Face推理端点访问和运行 Llama 3 NIM。

值得注意的是,英伟达还透露了一批大客户的使用情况,如电子制造商正在使用NIM开发针对特定领域的大语言模型(LLM),用于智能制造、智慧城市和智能电动汽车;和硕正在将NIM用于一个当地的混合专家(MoE)模型;劳氏公司正在用 NIM推理微服务来提升员工和客户的体验;西门子正在将其运营技术与NIM微服务整合,用于车间AI工作负载;还有数十家医疗保健公司正在部署NIM,为包括手术规划、数字助理、药物发现和临床试验优化等在内的应用领域的生成性AI推理提供支持。

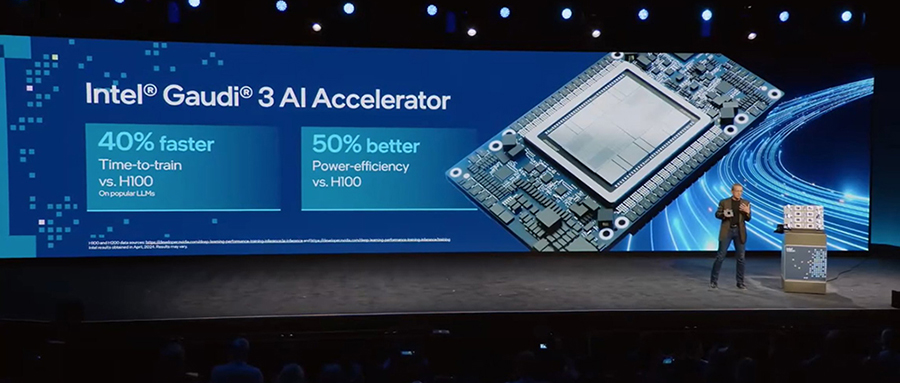

芯片开始投产

除了上述产品,黄仁勋还在演讲中透露,英伟达芯片已开始投产,并将在2025年推出 Ultra AI芯片。

今年5月,黄仁勋在财报电话会上称,预计今年架构芯片将为公司带来大量收入。英伟达对芯片寄予厚望,还是与市场强劲需求有关。从最新披露的财报数据来看,2025财年第一财季,英伟达实现营收260亿美元,较上年同期增长262%。其中,数据中心业务营收226亿美元,与上年同期相比增长427%,是业绩收入的“大头”。

据英伟达首席财务官科莱特•克雷斯解读,数据中心业务的增长源自架构GPU(例如H100)出货量的增加;该季度的重要亮点之一就是Meta宣布推出Lama 3开源大模型,使用了近2.4万块H100 GPU。

除了披露芯片量产进度,英伟达此次还推出了一系列采用架构的系统。

据悉,这些系统搭载了以及网络和基础设施,用于助力企业建立AI工厂和数据中心。其中, MGX模块化参考设计平台加入了对 产品的支持,包括专为主流大语言模型推理、检索增强生成和数据处理提供卓越性能打造的 GB200 NVL2平台。

英伟达强调,GB200 NVL2适合用于数据分析等新兴领域,借助—C2C互连技术带来的带宽内存性能及架构中专有的解压缩引擎,较使用时的数据处理速度可最多提速到18倍,能效提高8倍。“新一轮工业革命已经开始,众多企业和地区正在与合作推动价值万亿美元的传统数据中心向加速计算转型,并建造一种新型数据中心AI工厂来生产新的商品,人工智能。”黄仁勋称。

英伟达方面表示,目前已有超过25家合作伙伴的90多套已发布或正在开发中的系统使用了MGX参考架构,开发成本较之前最多降低了四分之三,开发时间缩短到六个月,较之前减少了三分之二。另外,英伟达还透露,比亚迪电子、西门子、泰瑞达和旗下公司等全球十多家机器人企业正在将加速库、基于物理学的仿真和AI模型集成到其软件框架和机器人模型中,以此提高工厂、仓库和配送中心的工作效率。

每日经济新闻